上篇文章中,我们把每个Message都是deliver到某个Consumer。在这篇文章中,我们将会将同一个Message deliver到多个Consumer中。这个模式也被成为 "publish / subscribe"。

这篇文章中,我们将创建一个日志系统,它包含两个部分:第一个部分是发出log(Producer),第二个部分接收到并打印(Consumer)。 我们将构建两个Consumer,第一个将log写到物理磁盘上;第二个将log输出的屏幕。

1. Exchanges

关于exchange的概念在《

RabbitMQ消息队列(一): Detailed Introduction 详细介绍》中有详细介绍。现在做一下简单的回顾。

RabbitMQ 的Messaging Model就是Producer并不会直接发送Message到queue。实际上,Producer并不知道它发送的Message是否已经到达queue。

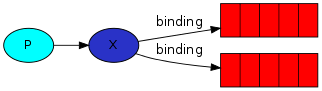

Producer发送的Message实际上是发到了Exchange中。exchange的功能也很简单:从Producer接收Message,然后投递到queue中。Exchange需要知道如何处理Message,是把它放到那个queue中,还是放到多个queue中?这个rule是通过Exchange 的类型定义的。

流程:

1)producer创建exchange,并且把message发送到exchange上

2)consumer创建同一个exchange,创建一个临时的queue,并且通过bind把临时queue绑定到这个exchange上

3)consumer订阅这个临时queue,也就是接收这个临时queue中的消息,这样producer就可以把消息发送给consumer

我们知道有三种类型的Exchange:

direct,

topic 和

fanout。fanout就是广播模式,会将所有的Message都放到它所知道的queue中。创建一个名字为logs,类型为fanout的Exchange:

2

3

2 type='fanout')

3

通过

rabbitmqctl可以列出当前所有的Exchange:

2

3

4

5

6

7

8

9

2Listing exchanges ...

3logs fanout

4amq.direct direct

5amq.topic topic

6amq.fanout fanout

7amq.headers headers

8...done.

9

注意

amq.* exchanges 和the default (unnamed)exchange是RabbitMQ默认创建的。

现在我们可以通过exchange,而不是routing_key来publish Message了

2

3

4

2 routing_key='',

3 body=message)

4

截至现在,我们用的queue都是有名字的:第一个是hello,第二个是task_queue。使用有名字的queue,使得在Producer和Consumer之间共享queue成为可能。

但是对于我们将要构建的日志系统,并不需要有名字的queue。我们希望得到所有的log,而不是它们中间的一部分。而且我们只对当前的log感兴趣。为了实现这个目标,我们需要两件事情:

1) 每当Consumer连接时,我们需要一个新的,空的queue。因为我们不对老的log感兴趣。幸运的是,如果在声明queue时不指定名字,那么RabbitMQ会随机为我们选择这个名字。

方法:

2

2

通过

result.method.queue 可以取得queue的名字。基本上都是这个样子:

amq.gen-JzTY20BRgKO-HjmUJj0wLg。

2)当Consumer关闭连接时,这个queue要被deleted。可以加个

exclusive的参数。

方法:

2

2

3. Bindings绑定

现在我们已经创建了fanout类型的exchange和没有名字的queue(实际上是RabbitMQ帮我们取了名字)。那exchange怎么样知道它的Message发送到哪个queue呢?答案就是通过bindings:绑定。

方法:

2

3

2 queue=result.method.queue)

3

现在logs的exchange就将它的Message附加到我们创建的queue了。

Listing bindings

使用命令

rabbitmqctl list_bindings。

4. 最终版本

我们最终实现的数据流图如下:

Producer,在这里就是产生log的program,基本上和前几个都差不多。最主要的区别就是publish通过了exchange而不是routing_key。

emit_log.py script:

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

2import pika

3import sys

4

5connection = pika.BlockingConnection(pika.ConnectionParameters(

6 host='localhost'))

7channel = connection.channel()

8

9channel.exchange_declare(exchange='logs',

10 type='fanout')

11

12message = ' '.join(sys.argv[1:]) or "info: Hello World!"

13channel.basic_publish(exchange='logs',

14 routing_key='',

15 body=message)

16print " [x] Sent %r" % (message,)

17connection.close()

18

还有一点要注意的是我们声明了exchange。publish到一个不存在的exchange是被禁止的。如果没有queue bindings exchange的话,log是被丢弃的。

Consumer:receive_logs.py:

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

2import pika

3

4connection = pika.BlockingConnection(pika.ConnectionParameters(

5 host='localhost'))

6channel = connection.channel()

7

8channel.exchange_declare(exchange='logs',

9 type='fanout')

10

11result = channel.queue_declare(exclusive=True)

12queue_name = result.method.queue

13

14channel.queue_bind(exchange='logs',

15 queue=queue_name)

16

17print ' [*] Waiting for logs. To exit press CTRL+C'

18

19def callback(ch, method, properties, body):

20 print " [x] %r" % (body,)

21

22channel.basic_consume(callback,

23 queue=queue_name,

24 no_ack=True)

25

26channel.start_consuming()

27

我们开始不是说需要两个Consumer吗?一个负责记录到文件;一个负责打印到屏幕?

其实用重定向就可以了,当然你想修改callback自己写文件也行。我们使用重定向的方法:

We're done. If you want to save logs to a file, just open a console and type:

Consumer1:打印到文件:

2

2

Consumer2:打印到屏幕:

2

2

接下来,Producer:

2

2

使用命令rabbitmqctl list_bindings你可以看我们创建的queue。

一个output:

2

3

4

5

6

2Listing bindings ...

3logs exchange amq.gen-JzTY20BRgKO-HjmUJj0wLg queue []

4logs exchange amq.gen-vso0PVvyiRIL2WoV3i48Yg queue []

5...done.

6